안녕하세요, 자체 SaaS를 직접 운영하며 보안 설계까지 챙기는 에그코드입니다.

요즘 챗GPT, 클로드로 직접 사이트를 만드는 비개발자 창업자가 정말 많아졌습니다.

빠르고, 저렴하고, 무엇보다 "동작하는" 결과물이 나옵니다.

하지만 저희가 운영 중인 자체 서비스의 공격 로그를 분석해보면 한 가지가 분명합니다.

빠르게 만들수록 더 많은 흔적을 남기고, 그 흔적은 모두 공격 표면이 됩니다.

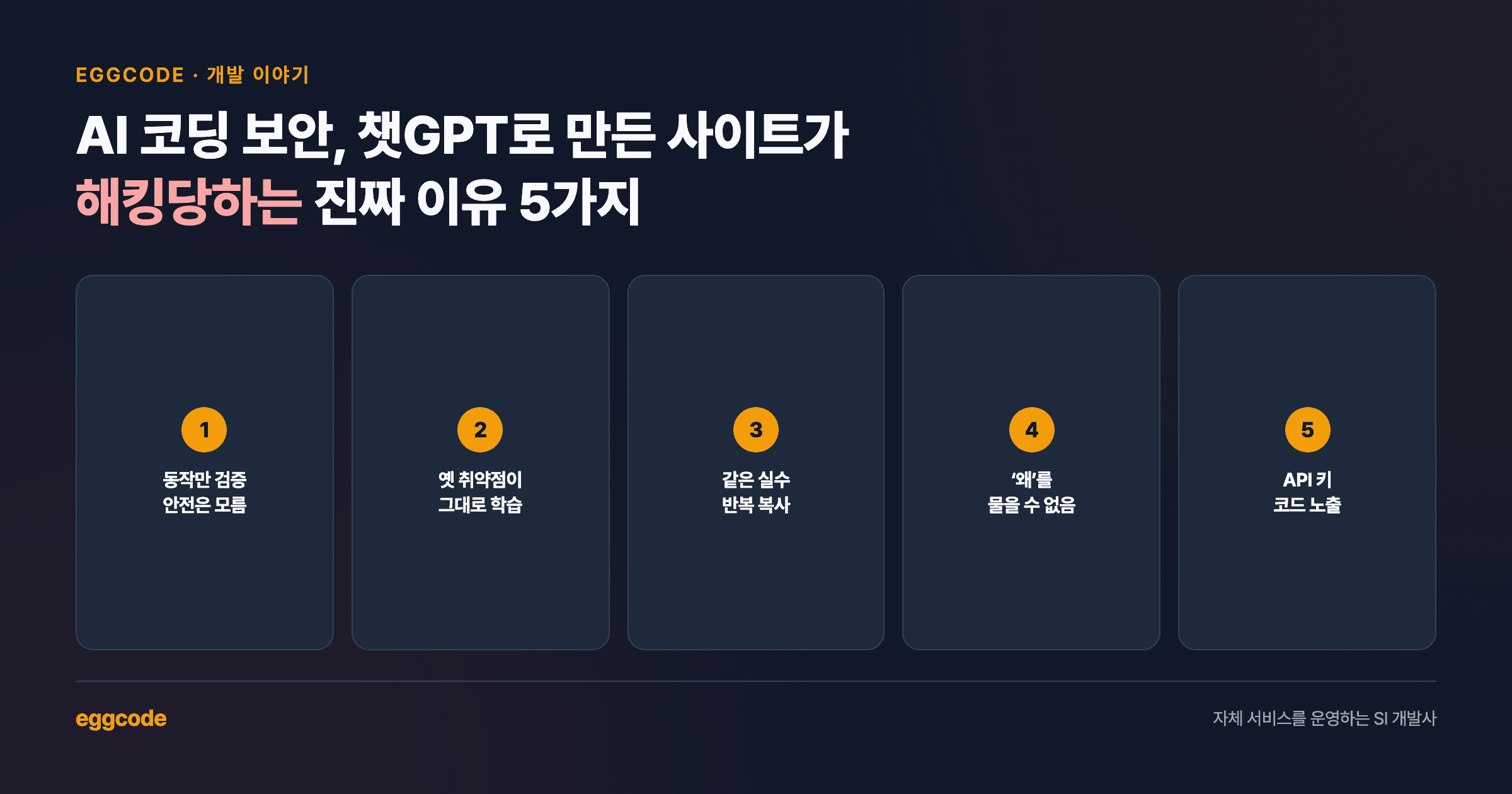

오늘은 AI 코딩 보안에서 비개발자 창업자가 놓치는 5가지를 정리합니다.

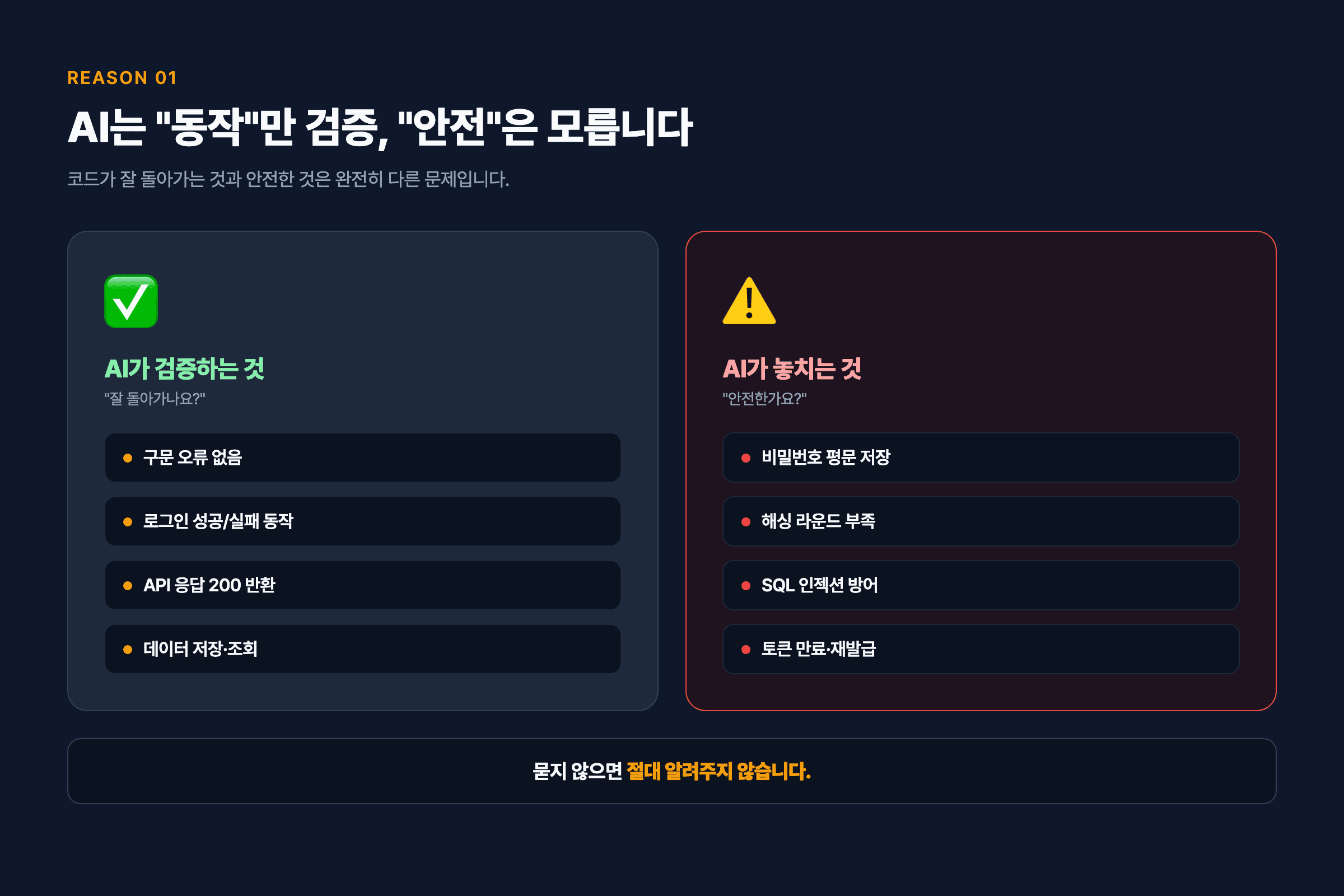

1. AI는 "동작"만 검증, "안전"은 모릅니다

챗GPT가 만든 로그인 코드는 잘 작동합니다.

하지만 비밀번호를 평문으로 저장하는지, 해싱 라운드가 충분한지는 묻지 않으면 알려주지 않습니다.

특히 입력값 검증, 권한 분리, 세션 만료 같은 기본 보안 원칙은 명시적으로 요구해야 반영됩니다.

2. 학습 데이터에 옛 취약점이 그대로 들어 있습니다

AI는 2010년대 후반의 코드도 그대로 학습했습니다.

이미 폐기된 md5 해싱이나 취약한 라이브러리 버전을 자연스럽게 추천합니다.

최신 모델이 나아졌다고 해도 라이브러리 버전 추천에서는 여전히 1~2년 뒤처진 코드를 내놓는 경우가 많습니다.

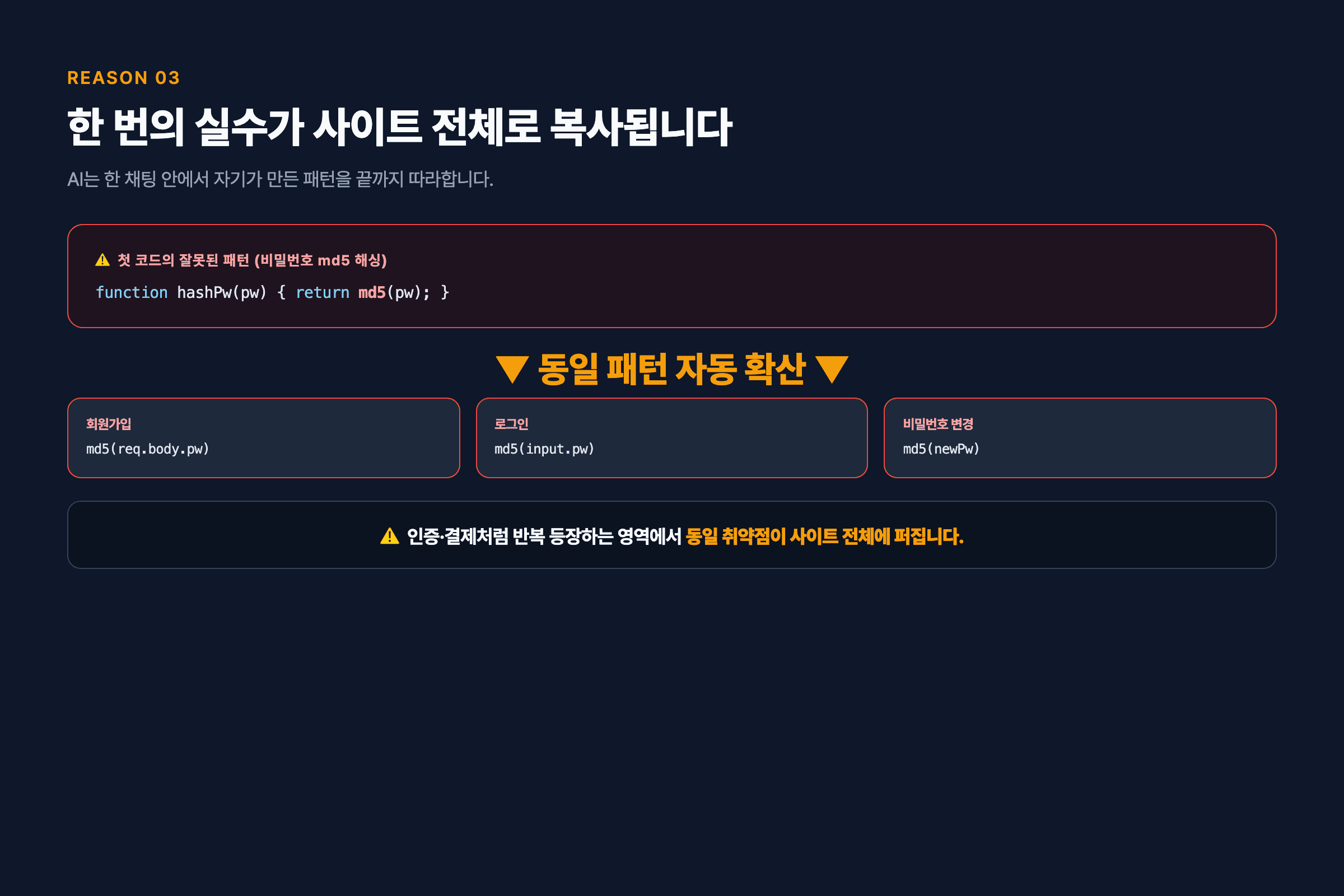

3. 같은 실수를 반복합니다

AI는 한 채팅 안에서 한 번 잘못된 패턴을 잡으면, 이후 모든 코드에 그 실수를 복사합니다.

특히 인증·결제처럼 반복 등장하는 영역에서 동일한 취약점이 사이트 전체에 퍼집니다.

발견 시점에는 이미 여러 모듈로 범위가 커져 있어 한 번에 고치기도 어렵습니다.

4. 비개발자는 "왜"를 물을 수 없습니다

코드가 동작하면 그대로 배포합니다.

하지만 SQL 인젝션 방어가 왜 필요한지 모르면, AI가 빼먹었을 때 절대 알아챌 수 없습니다.

방어 코드가 빠진 사실 자체를 알아야 질문할 수 있는데, 그 첫 단계가 막힙니다.

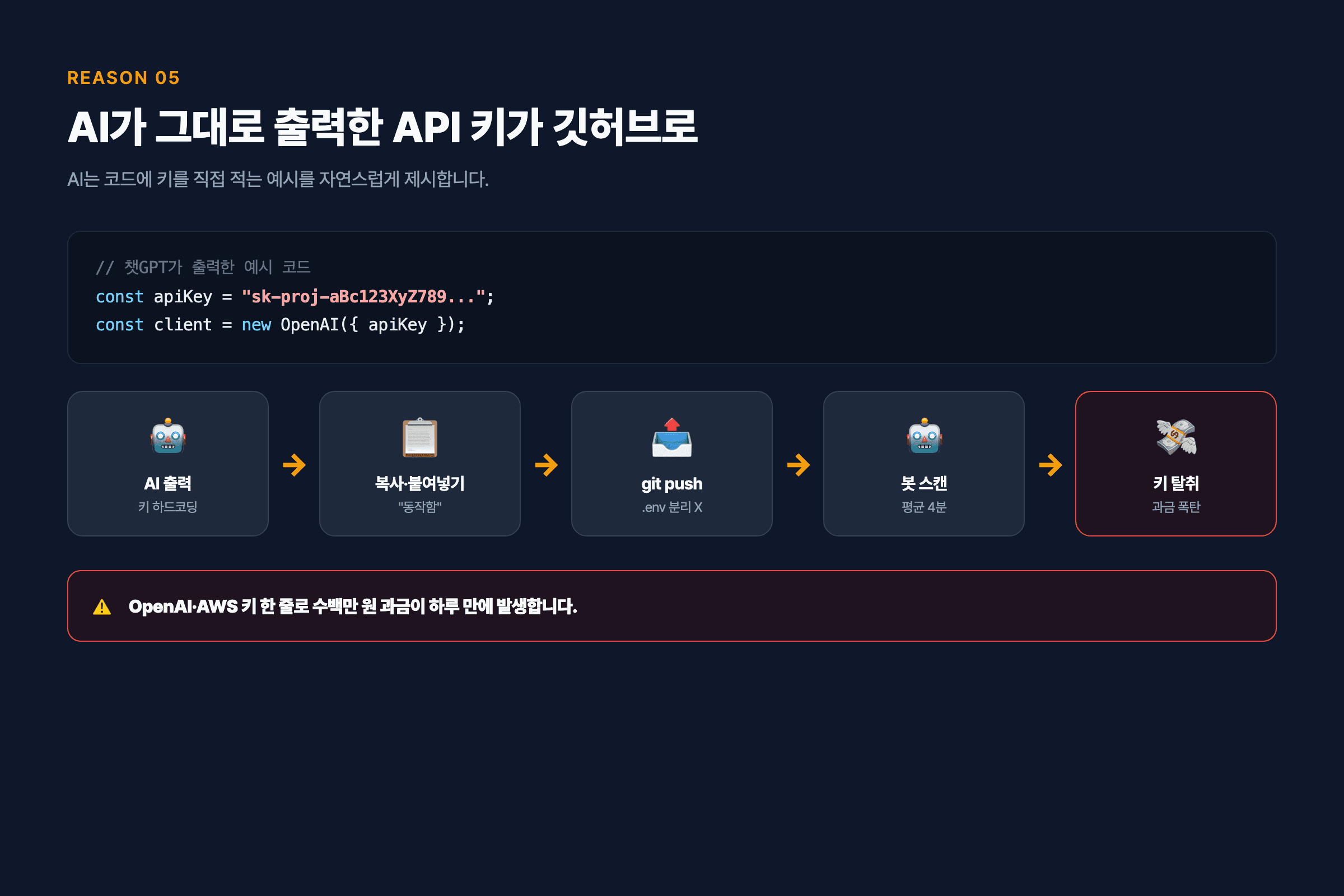

5. 환경변수·API 키 관리가 통째로 빠집니다

AI는 API 키를 코드에 직접 적는 예시를 그대로 출력합니다.

이걸 깃허브에 푸시하는 순간, AI 코딩 보안의 가장 흔한 사고가 발생합니다.

OpenAI나 AWS 키 한 줄이 한 시간 만에 수백만 원의 과금으로 이어지기도 합니다.

마치며

AI 코딩은 놀라운 도구이지만, 검수자 없이는 프로토타입에서 멈춰야 합니다.

저희 에그코드는 자체 서비스를 운영하며 매일 공격 로그를 봅니다.

그래서 AI가 생성한 코드를 그대로 배포하는 것이 얼마나 위험한지 누구보다 잘 압니다.

AI를 잘 쓰는 팀과 사고를 내는 팀의 차이는 결국 검수자의 유무에서 갈립니다.

그 검수자 역할이 필요하시다면, 에그코드가 AI 생성 코드의 보안 점검과 리팩토링을 맡아드립니다. 이론이 아니라, 실제 운영 중인 서비스의 관점에서 짚어드립니다.

이미 MVP를 운영 중이시라면, 더 근본적인 보안 점검 항목 7가지가 따로 있습니다.

MVP 단계에서 가장 자주 뚫리는 7가지 취약점

MVP 개발 보안, 실제 서비스 운영하며 발견한 취약점 7가지